note de L’éditeur: nous avons mis à jour notre article original sur les différences entre les GPU et les processeurs, rédigé par Kevin Krewell et publié en décembre 2009.

le processeur (unité centrale de traitement) a été appelé le cerveau d’un PC. Le GPU son âme. Au cours de la dernière décennie, cependant, les GPU sont sortis des limites boxy du PC.

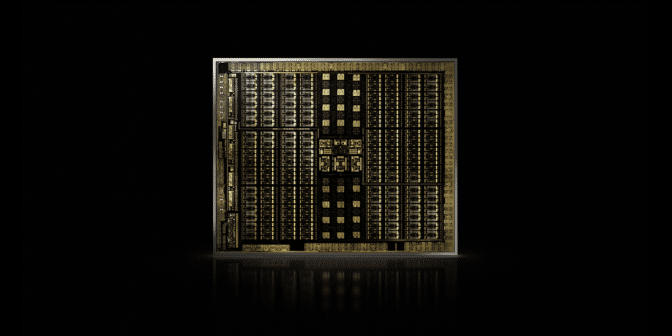

les GPU ont déclenché un boom mondial de L’IA. Ils sont devenus un élément clé du Supercalculateur moderne., Ils ont été tissés dans de nouveaux centres de données hyperscale tentaculaires. Toujours prisés par les joueurs, ils sont devenus des accélérateurs accélérant toutes sortes de tâches, du cryptage au réseau en passant par L’IA.

et ils continuent de stimuler les progrès dans les jeux et les graphiques pro dans les stations de travail, les PC de bureau et une nouvelle génération d’Ordinateurs portables.

qu’Est Ce qu’un GPU?

alors que les GPU (graphics processing unit) sont maintenant beaucoup plus que les PC dans lesquels ils sont apparus, ils restent ancrés dans une idée beaucoup plus ancienne appelée calcul parallèle. Et c’est ce qui rend les GPU si puissants.

Les Processeurs, pour être sûr, restent essentiels. Rapides et polyvalents, les processeurs courent à travers une série de tâches nécessitant beaucoup d’interactivité. Appel d’informations à partir d’un disque dur en réponse aux frappes de l’utilisateur, par exemple.

en revanche, les GPU décomposent les problèmes complexes en des milliers ou des millions de tâches distinctes et les résolvent à la fois.,

cela les rend idéales pour les graphiques, où les textures, l’éclairage et le rendu des formes doivent être faits à la fois pour garder les images volantes à travers l’écran.,v id= »bdcf9e66d4″>

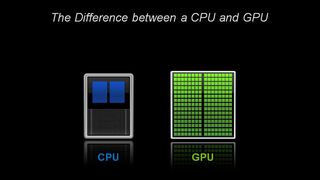

sur le plan Architectural, le PROCESSEUR est composé de seulement quelques cœurs avec beaucoup de mémoire cache qui peut gérer un logiciel de quelques fils à la fois., En revanche, un GPU est composé de centaines de cœurs qui peuvent gérer des milliers de threads simultanément.

Les GPU fournissent la technologie autrefois ésotérique du calcul parallèle. C’est une technologie avec un pedigree illustre qui comprend des noms tels que le génie du Supercalculateur Seymor Cray. Mais plutôt que de prendre la forme de superordinateurs gigantesques, les GPU ont mis cette idée au travail dans les ordinateurs de bureau et les consoles de jeu de plus d’un milliard de joueurs.

pour les GPU, L’Infographie première de nombreuses applications

Cette application — l’infographie — n’était que la première de plusieurs applications tueuses., Et il a entraîné l’énorme moteur R&d derrière les GPU. Tout cela permet aux GPU de devancer les puces à fonction fixe plus spécialisées desservant des marchés de niche.

un autre facteur rendant toute cette puissance accessible: CUDA. Publiée pour la première fois en 2007, la plate-forme de calcul parallèle permet aux codeurs de tirer parti de la puissance de calcul des GPU pour le traitement à usage général en insérant quelques commandes simples dans leur code.

cela permet aux GPU de proliférer dans de nouveaux domaines surprenants., Et avec la prise en charge d’un nombre croissant de normes-telles que Kubernetes et Dockers — les applications peuvent être testées sur un GPU de bureau à faible coût et étendues à des GPU de serveur plus rapides et plus sophistiqués ainsi qu’à tous les principaux fournisseurs de services cloud.

les processeurs et la fin de la Loi de Moore

avec la fin de la loi de Moore, les GPU, inventés par NVIDIA en 1999, sont arrivés juste à temps.

la loi de Moore postule que le nombre de transistors pouvant être entassés dans un circuit intégré doublera environ tous les deux ans. Pendant des décennies, cela a entraîné une augmentation rapide de la puissance de calcul., Cette loi, cependant, s’est heurtée à des limites physiques difficiles.

les GPU offrent un moyen de continuer à accélérer les applications — telles que les graphiques, le supercalcul et L’IA — en divisant les tâches entre de nombreux processeurs. De tels accélérateurs sont essentiels à l’avenir des semi-conducteurs, selon John Hennessey et David Patterson, lauréats du prix A.M. Turing 2017 et auteurs de Computer Architecture: a Quantitative Approach le manuel séminal sur les microprocesseurs.,

GPU: clé de L’IA, de la Vision par ordinateur, du supercalcul et plus encore

Au cours de la dernière décennie, cette clé s’est avérée essentielle pour une gamme croissante d’applications.

Les GPU effectuent beaucoup plus de travail pour chaque unité d’énergie que les processeurs. Cela en fait la clé des supercalculateurs qui, autrement, dépasseraient les limites des réseaux électriques actuels.

En IA, les GPU sont devenus la clé d’une technologie appelée « deep learning ». »L’apprentissage profond déverse de grandes quantités de données à travers les réseaux neuronaux, les entraînant à effectuer des tâches trop compliquées pour qu’un codeur humain puisse les décrire.,

IA et jeux: le Deep Learning alimenté par GPU est complet

Cette capacité d’apprentissage en profondeur est accélérée grâce à l’inclusion de cœurs tenseurs dédiés dans les GPU NVIDIA. Les cœurs tenseurs accélèrent les grandes opérations matricielles, au cœur de L’IA, et effectuent des calculs de multiplication et d’accumulation matriciels de précision mixte en une seule opération. Cela accélère non seulement les tâches D’IA traditionnelles de toutes sortes, mais il est maintenant exploité pour accélérer le jeu.,

Dans l’industrie automobile, les Gpu offrent de nombreux avantages. Ils offrent des capacités de reconnaissance d’image inégalées, comme vous pouvez vous y attendre. Mais ils sont également essentiels pour créer des véhicules autonomes capables d’apprendre et de s’adapter à un grand nombre de scénarios réels différents.,

en robotique, les GPU sont essentiels pour permettre aux machines de percevoir leur environnement, comme on peut s’y attendre. Cependant, leurs capacités D’IA sont devenues essentielles pour les machines capables d’apprendre des tâches complexes, telles que la navigation de manière autonome.

dans les soins de santé et les sciences de la vie, les GPU offrent de nombreux avantages. Ils sont idéaux pour les tâches d’imagerie, bien sûr. Mais le deep learning basé sur GPU accélère l’analyse de ces images. Ils peuvent croquer les données médicales et aider à transformer ces données, grâce à l’apprentissage en profondeur, en de nouvelles fonctionnalités.

en bref, les GPU sont devenus essentiels. Ils ont commencé par accélérer les jeux et les graphiques., Maintenant, ils accélèrent de plus en plus de domaines où la puissance informatique fera la différence.

- L’IA mange des logiciels

- L’IA entraîne la montée en puissance de L’Informatique accélérée dans les centres de données

- Quelle est la différence entre le traçage de rayons accéléré matériel et Logiciel?

- Qu’est-ce que Max-Q?

- qu’Est Ce qu’un processeur graphique Virtuel?

- Quelle est la différence entre le Ray Tracing et la rastérisation?,

- Quelle est la différence entre L’Intelligence Artificielle, L’apprentissage automatique et L’apprentissage profond?

- Qu’est-ce que NVLink?

- QU’est-ce que CUDA?